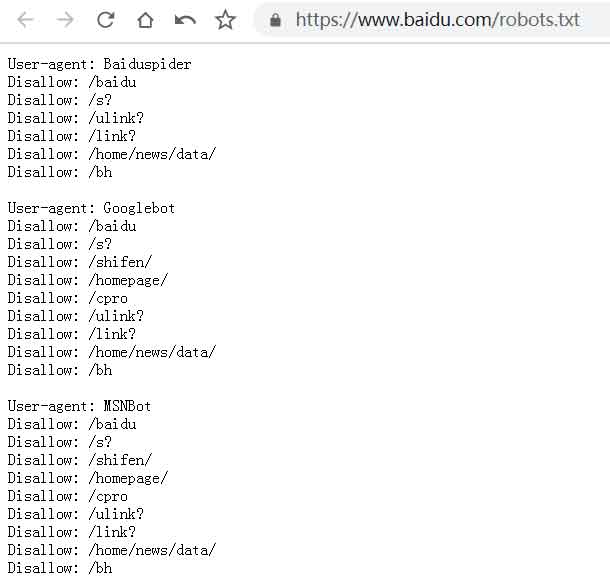

在SEO优化网站结构时,控制网页抓取、索引是常用的技术。一般情况下无需额外添加robots文件,部分时候需要禁止一些垃圾爬虫,则可以额外编写规则。以百度为例,百度是屏蔽了其它蜘蛛抓取百度家的搜索展示目录(https://www.baidu.com/robots.txt),常用工具包括:

机器人文件。

网页noindex标签。

nofollow属性链接。

网页301转向。

页面的标签等。

这些工具各有特定的应用场景,但都是用来控制网站内部结构的,容易混淆,经常需要配合使用。SEO必须准确理解这些工具的机制和原理,否则容易出错。

这个帖子讨论了robots文件。

robots文件是放置在域名(或子域名)根目录下的,文件名固定在robots.txt上,UTF8编码,纯ASCII文本文件,用于通知搜索引擎,网站的哪些部分可以被抓取,哪些是禁止的。robots.txt适用于域名(或子域名)。

在抓取网站页面之前,搜索引擎蜘蛛会先看看robots.txt的内容,哪些页面可以抓取,哪些页面被站长禁止抓取。当然,是否遵守robots文件的规则取决于自觉,有些坏蜘蛛不遵守,站长也没办法,比如收集内容,克隆网站。

所有搜索引擎支持的机器人文件记录包括:

Disallow-告诉蜘蛛不要抓取某些文件或目录。以下代码将阻止蜘蛛抓取所有站点文件:

User-agent:*

Disallow:/

Allow——告诉蜘蛛应该抓取一些文件。Allow和Disallow可以一起使用,告诉蜘蛛在某个目录下,大部分不抓,只抓一部分。以下代码将使蜘蛛不抓取ab目录下的其他文件,而只抓取cd下的文件:

User-agent:*

Disallow:/ab/

Allow:/ab/cd。

$通配符-匹配URL末尾的字符。以下代码允许蜘蛛访问以.htm为后缀的URL:

User-agent:*

Allow:。htm$。

*通配符——告诉蜘蛛匹配任何一个字符。以下代码将禁止蜘蛛抓取所有htm文件:

User-agent:*

Disallow:/*.htm

位置-告诉蜘蛛你的网站地图在哪里,格式如下:

Sitemap:

此外提醒大家注意,robots.txt文件可以不存在,返回404错误意味着蜘蛛可以抓取所有内容。但是在抓取robots.txt文件时,会出现超时等错误,可能会导致搜索引擎不包含网站,因为蜘蛛不知道robots.txt文件是否存在,或者里面有什么,这和确认文件不存在是不一样的。

此外,如果404页面包含一些URL,可能会导致搜索引擎错误地将404页面的内容视为robots文件的内容,从而导致不可预测的后果。因此,即使所有搜索引擎蜘蛛都想打开,也最好放一个robots文件,即使是空的。

掌握robots文件的使用和写索引擎优化的基本技能。当页面没有被收录或急剧下降时,机器人文件也应该首先检查。

谷子猫博客

谷子猫博客

发表评论